Evaluar en la era de la IA: cuando el examen tradicional ya no alcanza

El malestar tiene nombre

La irrupción de la IA generativa dejó expuesta una verdad incómoda: muchas de las consignas que usamos hace años pueden ser resueltas en segundos por cualquier estudiante con acceso a internet. Esto no es un problema tecnológico. Es una oportunidad, aunque duela, para preguntarnos qué estamos evaluando realmente.

Los detectores automáticos como Turnitin AI Detection, utilizados en más de la mitad de las universidades españolas, tienen una precisión promedio del 73 % y, cuando un estudiante parafrasea manualmente un texto generado por IA, el sistema solo lo detecta el 23 % de las veces (Javadex, 2026). En pocas palabras: la tecnología de detección ya perdió la carrera. Seguir confiando en ella como solución principal es una apuesta perdida.

No todas las consignas son iguales frente a la IA

Un marco útil para diagnosticar el problema es la Taxonomía de Bloom Digital (Churches, 2008): no todas las tareas cognitivas tienen la misma vulnerabilidad frente a la IA. Las consignas que piden recordar, definir o resumir (los niveles más básicos) son las más fáciles de delegar: la IA accede a toda la base de conocimiento factual y produce respuestas en segundos. Las que piden aplicar procedimientos estándar o traducir textos también, porque la IA sigue patrones lógicos con precisión.

En cambio, las consignas situadas en los niveles superiores: analizar, evaluar, crear son mucho más resistentes. No porque la IA no pueda generar algo, sino porque no conoce el contexto inmediato: las discusiones del aula, las experiencias del estudiante, los materiales trabajados en clase la semana pasada. Una consigna bien diseñada en esos niveles convierte lo personal e irrepetible en el corazón de la evaluación.

Rediseñar, no prohibir

Frente a este escenario, las universidades que están avanzando no son las que encontraron el mejor detector, son las que rediseñaron sus evaluaciones. Algunas apuestan por la evaluación oral: si el estudiante puede defender lo que entregó, importa menos cómo lo produjo. Otras están migrando hacia evaluaciones por competencias, donde el foco está en habilidades reales: análisis, resolución de problemas, pensamiento crítico en lugar de reproducir contenido (Klarway, 2025).

Tres estrategias concretas están ganando terreno. La primera es evaluar el proceso, no solo el producto: borradores, entregas parciales, bitácoras de decisión que muestren cómo el estudiante pensó. La segunda es anclar las consignas en lo local, lo reciente o lo trabajado en clase: aquello que la IA no vivió. La tercera, quizás la más audaz, es pedirle al estudiante que evalúe, corrija o cuestione lo que hizo la IA: convertir la herramienta misma en objeto de análisis.

Un estudio piloto con más de 2.300 estudiantes mostró que las tutorías con apoyo de IA mejoraron las calificaciones un 15 % en promedio (Javadex, 2026). Esto abre una pregunta que vale la pena sostener: si la IA puede ayudar a aprender mejor, ¿por qué seguimos evaluando como si no existiera?

El docente como diseñador, no como guardián

El cambio más profundo no está en la tecnología sino en el rol docente. Moreno (citado en Infobae, 2026) señala que los docentes necesitan dejar de pensarse como guardianes del conocimiento para convertirse en “orquestadores”: figuras que saben cuándo usar una herramienta, para qué y con qué límites. El mismo autor advierte que cuando no existe una estrategia clara de adopción de IA, el retorno de inversión es nulo: las instituciones compran licencias, las distribuyen, y tres meses después nadie sabe qué hacer con ellas.

Rediseñar la evaluación no significa cambiar toda la materia de golpe. Significa elegir una consigna, la que hoy la IA resuelve en dos segundos, y hacerle una sola pregunta: ¿qué parte de esta tarea solo puede hacer este estudiante, en este contexto, con lo que vivió en este curso? La respuesta a esa pregunta es el punto de partida del rediseño.

El riesgo de la brecha

Hay una dimensión que las instituciones no pueden ignorar. Mientras la adopción de IA en el Norte Global supera el 24 %, en América Latina y el Caribe el acceso sigue siendo profundamente desigual (USFA, 2026). El Banco Mundial (2025) advierte que la región requiere acciones urgentes para que las instituciones aprovechen las oportunidades de la IA sin ampliar las brechas existentes. Tener acceso a una herramienta no es lo mismo que saber usarla con criterio y eso vale tanto para estudiantes como para instituciones.

La evaluación justa en la era de la IA no es solo una cuestión pedagógica. Es también una cuestión de equidad.

¿Qué sigue?

El 2026 está consolidando un punto de inflexión: las universidades que seguían esperando que “la situación se acomode” están quedando atrás (Klarway, 2025). La IA no reemplaza al aprendizaje auténtico pero sí obliga a ser más honestos sobre qué estamos evaluando realmente.

¿Tu consigna mide lo que el estudiante aprendió, o lo que la IA puede producir? Ese es el único diagnóstico que importa ahora mismo.

Referencias

Banco Mundial. (2025, 6 de mayo). Revolución de la inteligencia artificial en la educación superior: lo que hay que saber. https://www.bancomundial.org/es/region/lac/publication/ia-educacion-superior-inteligencia-artificial

Churches, A. (2008). Bloom’s digital taxonomy. ResearchGate. https://www.researchgate.net/publication/228381038_Bloom’s_Digital_Taxonomy

Javadex. (2026, marzo). IA en la educación española: cómo las universidades están transformando la enseñanza [2026]. https://www.javadex.es/blog/ia-educacion-espanola-universidades-guia-2026

Klarway. (2025, 12 de diciembre). 6 tendencias que marcarán la evaluación online en 2026. https://klarway.com/6-tendencias-que-marcaran-la-evaluacion-online-en-2026/

Moreno, J. (2026, 9 de marzo). Qué tienen que saber las escuelas, universidades y empresas al dar el salto a la inteligencia artificial [Entrevista]. Infobae. https://www.infobae.com/educacion/2026/03/09/que-tienen-que-saber-las-escuelas-universidades-y-empresas-al-dar-el-salto-a-la-inteligencia-artificial/

USFA. (2026, 9 de febrero). Universidad 2026: cuando la IA deja de ser un ‘chat’ y se convierte en infraestructura cognitiva. https://www.usfa.edu.bo/blog/pregrado/post/universidad-2026-cuando-la-ia-deja-de-ser-un-chat-y-se-convierte-en-infraestructura-cognitiva

Nota de transparencia

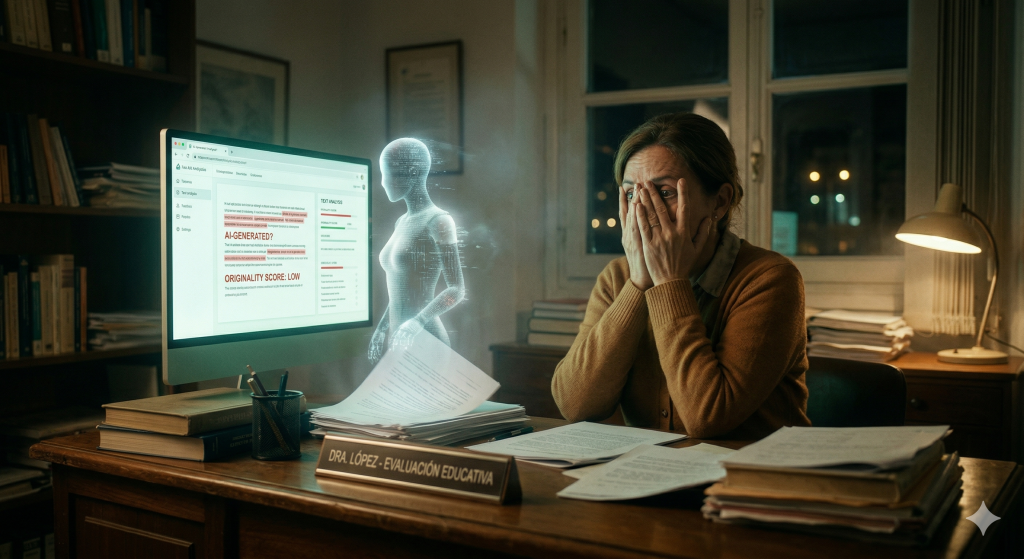

La imagen ha sido creada utilizando el modelo Gemini 3 Flash Image (Nano Banana 2). El prompt fue diseñado para capturar visualmente la tensión emocional y los desafíos pedagógicos que enfrentan los docentes ante la irrupción de las herramientas generativas en los procesos de evaluación educativa. En lo que respecta al artículo, fue elaborado con asistencia de inteligencia artificial: la búsqueda y síntesis de fuentes se realizó con apoyo de Claude (Anthropic), y las referencias fueron verificadas manualmente. El texto final fue revisado y ajustado por un editor humano. Ser transparentes sobre cómo usamos estas herramientas es, también, parte de lo que este observatorio quiere enseñar.