Chatbots que enseñan a pensar

Pocas discusiones atraviesan hoy las salas de profesores con tanta intensidad como esta: ¿Las IA atrofian el pensamiento crítico de los estudiantes o lo potencian? La respuesta corta y honesta es que depende. Depende de cómo se usen. Depende de cómo articulemos los docentes las actividades con la IA. Y, sobre todo, depende de qué hagamos los docentes para enmarcar ese uso. Un estudio reciente publicado en Learning and Instruction aporta evidencia empírica robusta para sostener esa tesis, y la experiencia cotidiana en el aula universitaria la confirma.

Lo que reveló un famoso trabajo italiano

Un grupo de investigadores de la Universidad de Messina evaluó a 213 estudiantes universitarios de entre 18 y 30 años. Combinaron cuestionarios autoinformados sobre actitudes y confianza hacia la inteligencia artificial con una medida estandarizada de razonamiento complejo: la Critical Reasoning Assessment (Suriano et al., 2025).

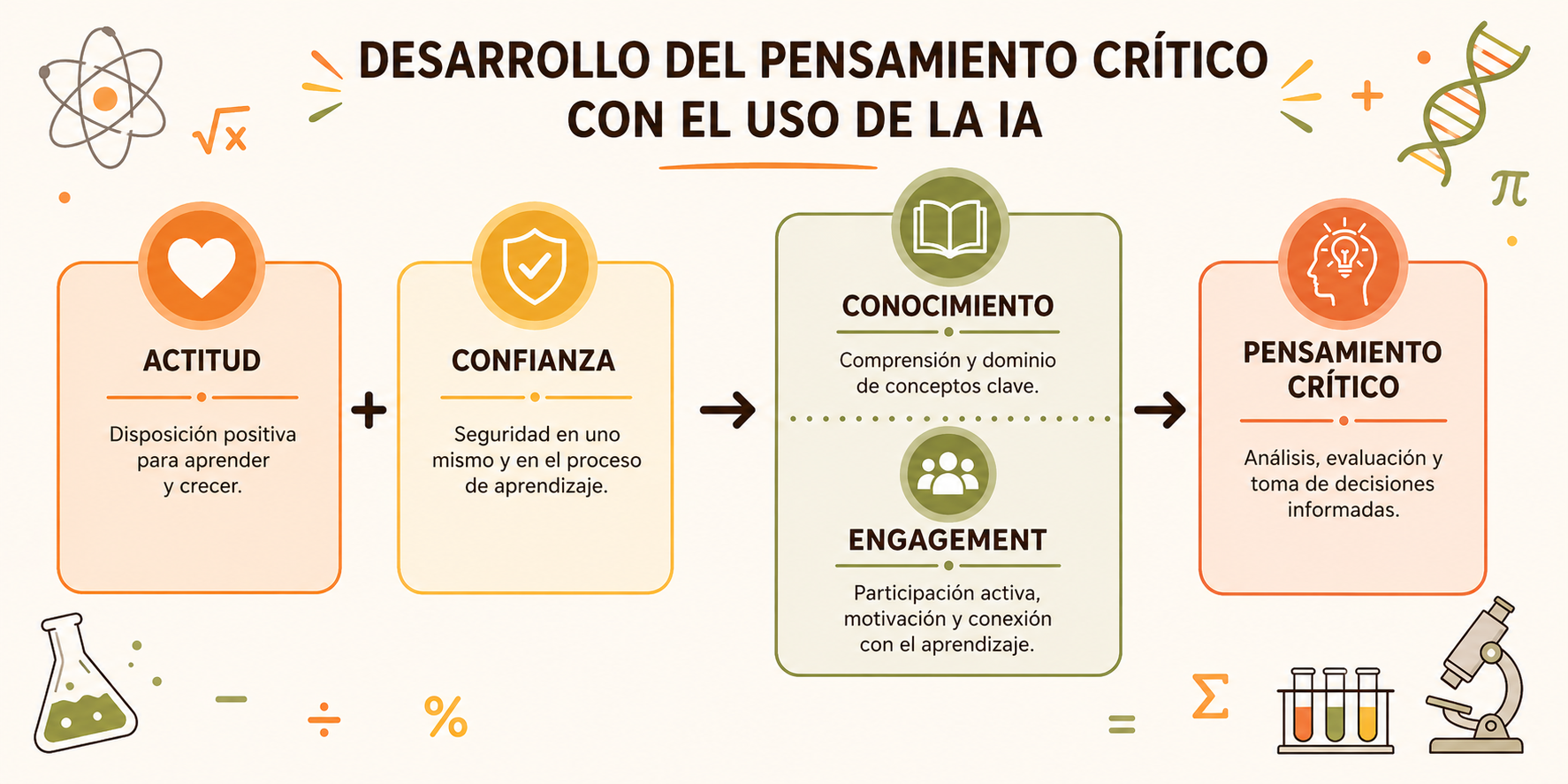

El hallazgo central es contraintuitivo y, a la vez, esperanzador. Cuando los estudiantes mostraban una actitud positiva y de confianza hacia la IA, esto se traducía en mayor conocimiento y mayor compromiso (engagement) con la herramienta. Pero el dato más relevante, el que obliga a repensar la configuración didáctica, es este: el compromiso activo con el chatbot impactó más significativamente sobre el desempeño en pensamiento crítico que el mero conocimiento técnico de la herramienta. Dicho de otro modo, no alcanza con saber qué es ChatGPT ni con haberlo usado: hay que comprometerse en una interacción genuina con él, evaluando, reformulando, dudando.

La conclusión de los autores es que la IA conversacional puede ser un recurso valioso para desarrollar el pensamiento crítico, pero requiere un enfoque educativo que promueva la interacción y la revisión de las respuestas.

El reverso de la moneda

Ahora bien, si la clave es compromiso activo, ¿qué ocurre cuando ese compromiso falta? La respuesta, también respaldada por evidencia, es preocupante. Un estudio publicado en 2025 en el British Journal of Educational Technology por Hou y colaboradores analizó las conductas de uso de IA generativa en 808 estudiantes universitarios mientras resolvían problemas. Los autores distinguieron empíricamente cuatro patrones: uso reflexivo, uso cauteloso, uso colaborativo y uso irreflexivo (thoughtless use).

El delegar la tarea sin revisarla, sin contrastarla, sin cuestionarla, configura precisamente ese cuarto patrón: el uso irreflexivo. Y los resultados son inequívocos: cuanto más bajo es el pensamiento crítico inicial del estudiante, mayor es la probabilidad de caer en este modo de uso. Se produce así un círculo vicioso: el estudiante que más necesitaría desarrollar pensamiento crítico es justamente el que más tiende a delegar acríticamente, perpetuando su déficit.

Este es un fuerte llamado de atención; la misma herramienta que puede potenciar el pensamiento crítico también puede impedirlo. Lo que decide el resultado no es la tecnología, sino la postura del estudiante frente a ella. La buena noticia es que (como todo) el buen uso se enseña.

Lo que vemos en el aula

Esta evidencia coincide con lo que observo desde hace tiempo en mi cátedra de la Licenciatura de Informática y Diseño de Software. En clase promuevo deliberadamente el uso de distintos chatbots (principalmente Claude y Jotform preentrenado con mi material de cátedra) para que los estudiantes pongan a prueba sus propios conocimientos. Concretamente, les propongo a mis estudiantes que usen ciertos prompts para que la IA los interrogue sobre sus conocimientos. ¿Ven la inversión didáctica? La IA no es la que da las respuestas, sino el estudiante. La IA está para hacer preguntas como las que yo haría en un examen final y, luego, les ofrece una retroalimentación con los aspectos positivos, los errores conceptuales y recomendaciones de mejora.

El patrón que emerge ha probado ser consistente: los estudiantes que se entrenan activamente con chatbots argumentan mejor en los exámenes finales y obtienen calificaciones más altas. Esta observación, lejos de ser anecdótica, encuentra respaldo experimental en el trabajo de Hui Hong y colegas (2025), un estudio cuasiexperimental con 240 estudiantes a lo largo de doce semanas que demostró que cuando la IA generativa se integra mediante un andamiaje pedagógico deliberado, el grupo experimental mejora significativamente tanto en pensamiento crítico estandarizado como en la calidad de sus producciones escritas.

Ahora bien, en clases no todos los estudiantes aprovechan la IA de la misma manera (todo sea dicho). Siempre habrá estudiantes que usen la IA para que les hagan los trabajos prácticos, sin diálogo ni verificación de resultados. Esto es algo que nos interpela como docentes: ¿por qué no les interesa llegar a un aprendizaje significativo? ¿Por qué no encuentran valor en desarrollar el pensamiento crítico? ¿Por qué aprobar la materia es un objetivo en sí mismo? Muchas preguntas y muchas respuestas; el factor más frecuente es que no alcanzan a ver un valor formativo en nuestra asignatura.

Si ponemos en consideración todo lo anterior, podemos ver que el docente no queda fuera de juego. Al contrario: nunca fue más necesario. Nuestra tarea no es proteger al estudiante de la IA, sino enseñarle a usarla como un buen compañero de estudio. El día de mañana, la usarán como un colaborador cuando sean profesionales en ejercicio.

Para ser optimistas

La inteligencia artificial generativa puede utilizarse como un recurso interactivo para el desarrollo del pensamiento crítico, pero hay que pensarlo estratégicamente.

Si el estudiante delega el esfuerzo de aprender, saldrá perjudicado. Si el docente prohíbe sin proponer alternativas, también. Pero si la práctica de aula transforma al chatbot en un interlocutor que obliga a argumentar, comparar, dudar y refutar, entonces la IA se convierte en lo que siempre fueron las grandes herramientas educativas: un espejo que devuelve al estudiante la imagen de su propio pensamiento amplificado. La oportunidad pedagógica está abierta, y la evidencia empírica empieza a confirmar lo que la intuición docente ya sospechaba: enseñar a pensar con IA es el desafío que tenemos por delante.

Agradecimientos

Un agradecimiento particular a Rosa Angela Fabio, coautora junto con Rossella Suriano, Alessio Plebe y Alessandro Acciai del paper Student interaction with ChatGPT can promote complex critical thinking skills, por facilitarme el texto completo.

El paper citado ha sido ampliamente comentado en las redes sociales, aunque no siempre con justicia. De hecho, ha servido para producir algunas fake news sensacionalistas, por lo que en este artículo quise poner en foco los resultados reales a los que arribó el equipo de investigación.

Uso transparente de la IA

Artículo elaborado con asistencia de Claude (análisis y síntesis del paper fuente, redacción colaborativa). Artículos científicos complementarios localizados con Scite.

La versión final de esta publicación fue revisada, corregida y completada por el autor.

Imágenes ilustrativas generadas por ChatGPT.

Referencias citadas:

- Hong, H., Vate-U-Lan, P., & Viriyavejakul, C. (2025). Cognitive Offload Instruction with Generative AI: A Quasi-Experimental Study on Critical Thinking Gains in English Writing. Forum for Linguistic Studies, 7(7).

- Hou, C., Zhu, G., & Sudarshan, V. K. (2025). The role of critical thinking on undergraduates' reliance behaviours on generative AI in problem-solving. British Journal of Educational Technology, 56(5), 1919-1941.

- Suriano, R., Plebe, A., Acciai, A., & Fabio, R. A. (2025). Student interaction with ChatGPT can promote complex critical thinking skills. Learning and Instruction, 95, 102011.